Prima di andare avanti c'è da fare una osservazione

sulla notazione. Per alleggerire le formule indicheremo

con ![]() ,

, ![]() , etc. direttamente i valori veri

delle grandezze (precedentemente

indicati con

, etc. direttamente i valori veri

delle grandezze (precedentemente

indicati con ![]() ,

, ![]() , etc.)

e non più quelli osservati. Con

, etc.)

e non più quelli osservati. Con ![]() e

e ![]() saranno invece indicati i valori attesi dei valori veri

(in pratica le medie aritmetiche ottenute dalle misure dirette).

saranno invece indicati i valori attesi dei valori veri

(in pratica le medie aritmetiche ottenute dalle misure dirette).

Per capire bene il problema, partiamo da variabili discrete. Per

semplicità prendiamo due grandezze,

![]() e

e ![]() , che possono assumere soltanto

tre valori, con distribuzione uniforme.

Ad esempio:

, che possono assumere soltanto

tre valori, con distribuzione uniforme.

Ad esempio: ![]() ,

, ![]() ,

, ![]() ;

;

![]() ,

, ![]() ,

, ![]() . Essendo tutti i valori

equiprobabili abbiamo:

. Essendo tutti i valori

equiprobabili abbiamo:

![]() .

Se adesso siamo interessati alla variabile

.

Se adesso siamo interessati alla variabile ![]() , l'incertezza

sul valore di

, l'incertezza

sul valore di ![]() e di

e di ![]() si propaga sul

valore di

si propaga sul

valore di ![]() .

.

Il caso discreto con tre soli valori possibili permette

di seguire il ``flusso di incertezza'', come mostrato in

tabella 17. La variabile ![]() può essere

un numero compreso fra 13 e 16, ma a differenza di

può essere

un numero compreso fra 13 e 16, ma a differenza di ![]() e di

e di

![]() , i valori non sono tutti equiprobabili. Infatti, mentre

i valori estremi si possono verificare per una particolare

coppia di

, i valori non sono tutti equiprobabili. Infatti, mentre

i valori estremi si possono verificare per una particolare

coppia di ![]() e di

e di ![]() , ci sono più coppie che possono

produrre gli altri valori. In particolare, il valore

, ci sono più coppie che possono

produrre gli altri valori. In particolare, il valore ![]() è quello più probabile semplicemente perché esso

può essere ottenuto da possibili coppie.

è quello più probabile semplicemente perché esso

può essere ottenuto da possibili coppie.

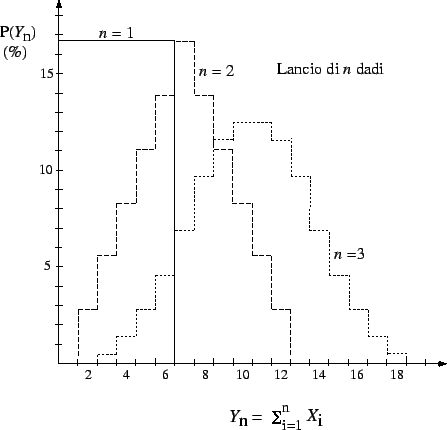

Un caso analogo, leggermente più complicato, è mostrato in figura 8. Si tratta delle distribuzioni di probabilità della somma degli esiti di 1, 2 e 3 dadi.

|

Si capisce inoltre come, per simmetria, la distribuzione delle differenze intorno al valore centrale debba essere uguale a quella delle somme.

Quindi, per due variabili indipendenti si ottiene la seguente regola di propagazione:

Dalla (21)

si ottiene la regola generale per una funzione qualsiasi,

mediante linearizzazione intorno ai valori attesi. Infatti se

indichiamo con ![]() la generica funzione delle due variabili

casuali

la generica funzione delle due variabili

casuali ![]() e

e ![]() , abbiamo

, abbiamo

Si ricordi che la (22) è basata su una linearizzazione.

La funzione deve essere abbastanza lineare un certo numero

di deviazioni standard intorno alle migliori stime delle

variabili di partenza.

Questo è generalmente vero

se le ![]() sono molto minori delle stime. Se la funzione è lineare

non c'è nessun vincolo sul valore di

sono molto minori delle stime. Se la funzione è lineare

non c'è nessun vincolo sul valore di ![]() . Ad esempio,

se

. Ad esempio,

se ![]() , con

, con

![]() e

e

![]() , si ha

, si ha

![]() .

.

Per quanto riguarda l'uso della formula di propagazione, si raccomanda di fare una lista dei contributi all'incertezza totale dovuti a ciascun termine da cui la grandezza finale dipende. Questo permette di capire quale contributo sia maggiormente responsabile e sul quale bisogna intervenire al momento di pianificare un nuovo esperimento. Quindi la formula (22) può essere riscritta nel seguente modo, didatticamente più valido: